NSDT工具推荐: Three.js AI纹理开发包 - YOLO合成数据生成器 - GLTF/GLB在线编辑 - 3D模型格式在线转换 - 可编程3D场景编辑器 - REVIT导出3D模型插件 - 3D模型语义搜索引擎 - AI模型在线查看 - Three.js虚拟轴心开发包 - 3D模型在线减面 - STL模型在线切割 - 3D道路快速建模

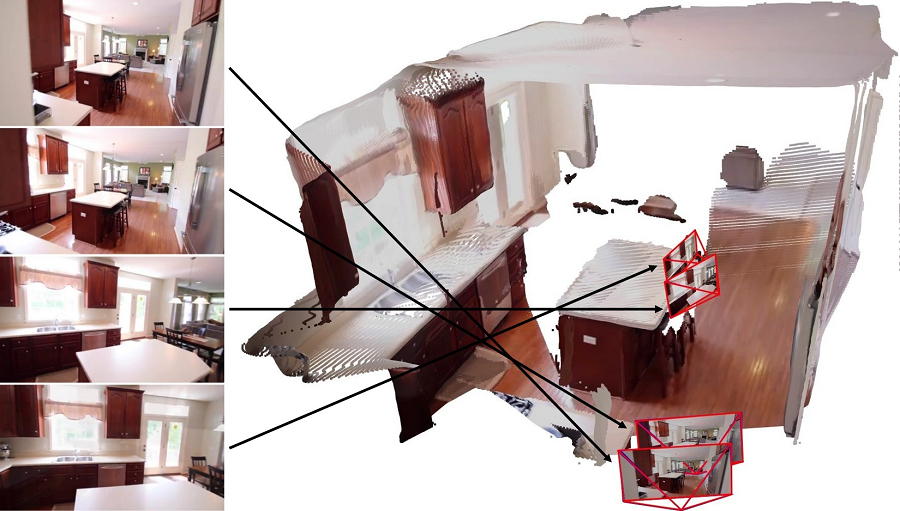

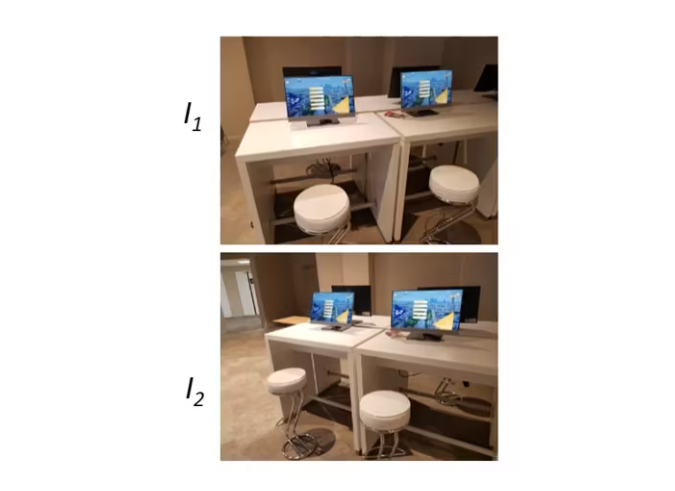

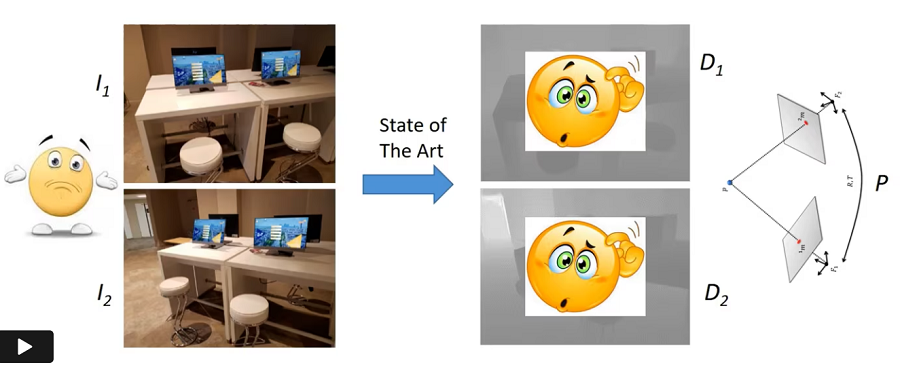

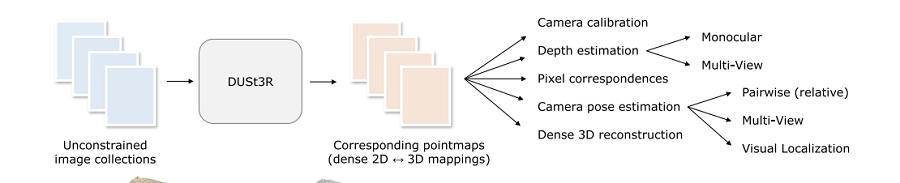

3D 重建是从二维 (2D) 图像创建对象或场景的 3D 虚拟表示的任务,可用于模拟、可视化或本地化等多种目的。 它广泛应用于计算机视觉、机器人和虚拟现实(VR)等多个领域。 在基本设置中,3D 重建方法输入一对图像 I1 和 I2,并输出两个图像的深度图 D1 和 D2,以及它们之间的相对姿态 P,如下图 1 所示。

如果两个图像的相机参数(内在参数)已知,则当前最先进的多视图立体重建 (MVS) 方法(例如 DeMoN [1] 和 DeepV2D [2])可以完成此任务,如视频 1 所示。 ,不仅需要提供内在函数,而且做出良好估计的过程相当繁琐,并且经常容易出错。

如果相机参数未知或估计不当,则 3D 重建会失败,如视频 2 所示。

DUSt3R方法更简单的主要优点是,通过直接对图像内容进行操作,它可以估计图像深度D1、D2和姿态P,并在不知道相机参数的情况下生成完整的3D重建。

1、DUSt3R 的工作原理

DUSt3R 不受约束,因为它解决了在没有相机参数或视点姿势信息的情况下从图像进行 3D 重建的挑战。 该系统的工作原理是将成对重建制定为点图回归,这使其与标准投影相机模型有很大不同。 该网络有效地从图像对中解码出具有丰富几何细节的点图,从而简化了提取详细场景几何图形的过程。

网络架构基于标准 Transformer 编码器和解码器,这意味着我们可以利用现有强大的预训练模型。 我们的公式直接提供场景的 3D 模型以及深度信息,但我们还可以无缝恢复像素匹配以及相对和绝对相机姿势。

2、从两个相反的图像重建

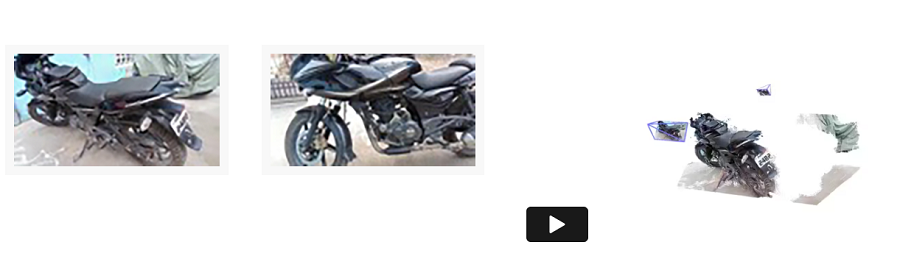

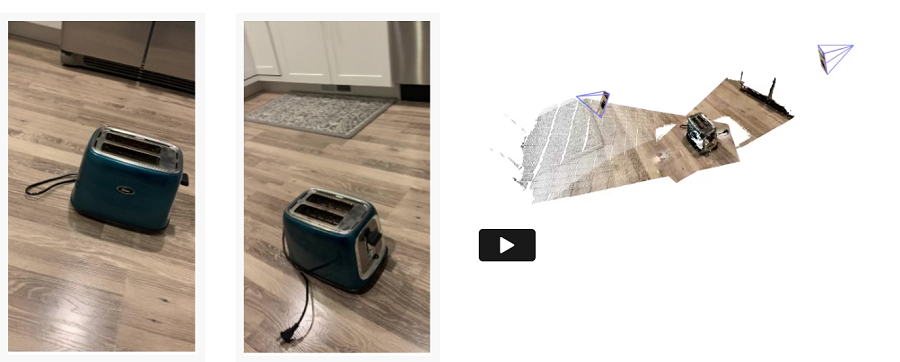

下面是从物体几乎相反的视点进行 3D 重建的几个示例。 对于每种情况(长凳、摩托车和烤面包机),我们都会显示两个输入图像和动画可视化视频。 即使图像之间几乎没有重叠的视觉内容:

DUSt3R 也能轻松处理剧烈的视点变化,例如摩托车:

3、从一张图像重建

DUSt3R 甚至能够从单个图像重建 3D 场景,如下图 3 所示:

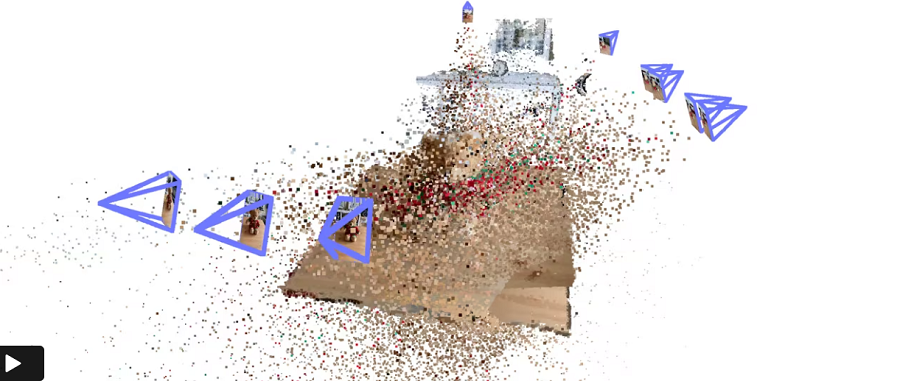

4、多视角全局优化

在提供多个视图的情况下,DUSt3R 提出了一种简单而有效的全局优化策略,该策略在公共参考系中表达所有成对点图:

5、将多个任务集成到单个管道中

DUSt3R 最重要的功能是能够将传统上单独处理的各种 3D 视觉任务统一到一个简化的管道中。 DUSt3R 架构利用预训练模型和完全数据驱动的方法来学习强大的几何和形状先验。 此过程会产生场景的直接 3D 模型,这些模型也适用于深度和姿态估计、视觉定位和多视图 3D 重建等任务。

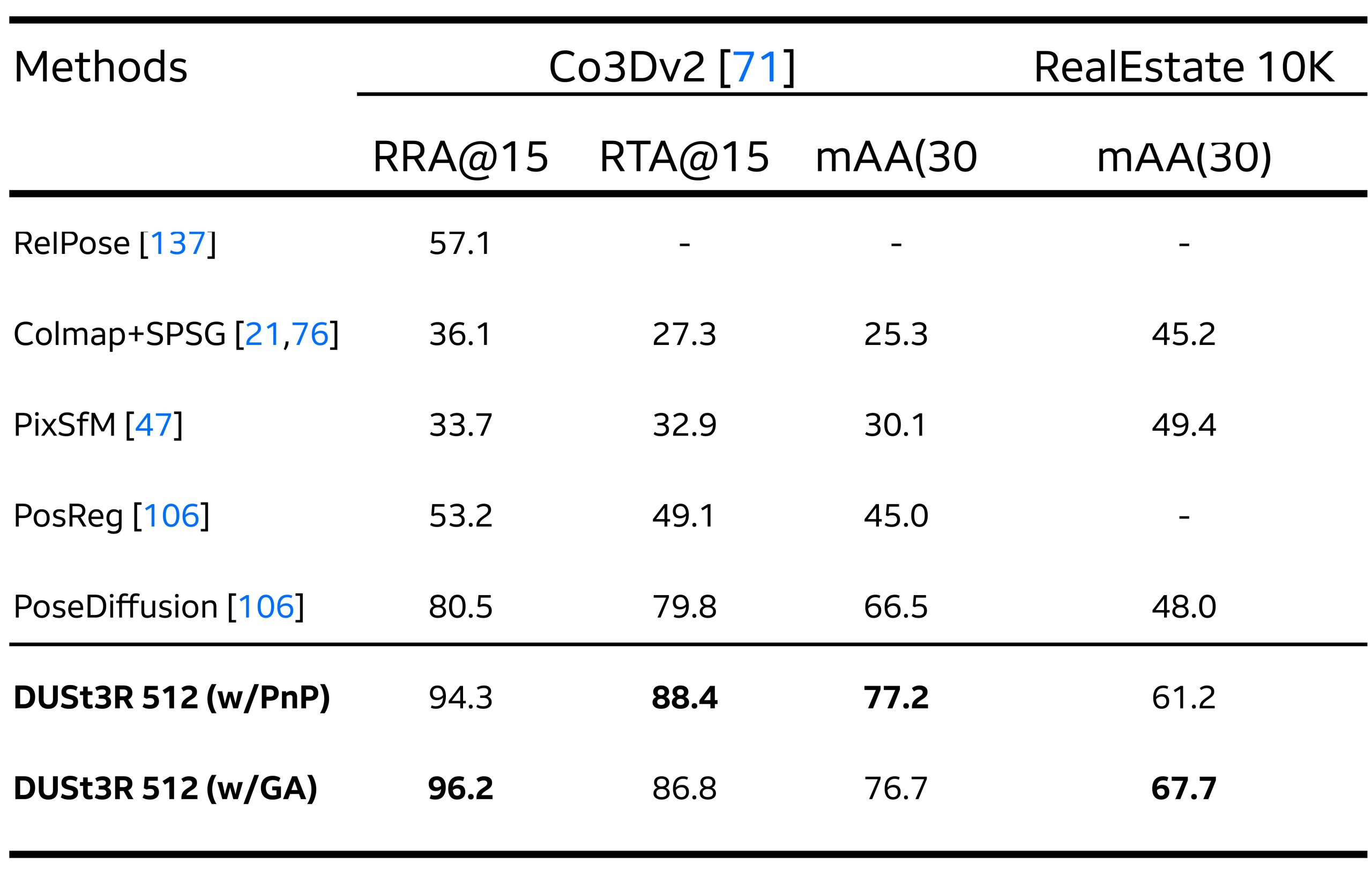

6、评价结果

DTU、Tanks and Temples 和 ETH3D 等数据集的实验结果表明,DUSt3R 在相机参数未知的情况下也能工作。 该网络可以处理单眼重建并在公共参考系中对齐多个图像对。 评估将 DUSt3R 定位为设定新标准,在包括多视图/单目深度估计和相机姿态估计在内的一系列任务中实现最先进的结果。 下面的表 1 将 DUSt3R 与 CO3Dv2 和 RealEst10K 数据集上的多视图姿态回归任务中最先进的方法进行了比较(详细信息请参阅论文 [3])。

7、结束语

DUSt3R 代表了 3D 几何视觉的重大进步,比传统方法有了显着的简化。 结果强调了其在处理各种 3D 视觉挑战方面的潜力和多功能性,而无需进行详尽而细致的估计和校准相机参数的步骤,这代表着 3D 重建领域的未来发展向前迈出了重要一步。

原文链接:3D reconstruction models made easy

BimAnt翻译整理,转载请标明出处